搜索网站、位置和人员

电话: +86-(0)571-86889887 工学院

近日,第36届神经信息处理系统大会NeurIPS(Conference on Neural Information Processing Systems)大会在美国召开。作为目前全球最负盛名的人工智能盛会之一,NeurIPS在每年年末都是计算机科学领域瞩目的焦点。西湖大学工学院李子青实验室、张岳实验室和原发杰实验室共有5篇成果入选。

基于知识蒸馏的图结构增广框架:缓解图结构分布偏移引起的负增广问题

Knowledge Distillation Improves Graph Structure Augmentation for Graph Neural Networks

吴立荣

李子青实验室2020级博士生

<背景知识>

图结构数据是由若干给定的顶点及连接两顶点的边所构成的数据结构,这种数据通常用来描述事物之间的某种特定关系。图神经网络是一种专门用于学习图结构数据的神经网络,它提取和发掘图结构数据中的特征和模式,可用于分类、回归、生成等多种任务。知识蒸馏(Knowledge Distillation)利用性能较好的大模型的监督信息来训练一个小模型,以期达到更好的性能和精度。知识蒸馏与现实生活中“教师-学生”非常类似,我们将大模型称之为Teacher(教师模型),小模型称之为Student(学生模型)。来自Teacher的监督信息被称之为knowledge(知识),而Student学习来自Teacher的监督信息的过程被称之为distillation(蒸馏)。

<技术介绍>

数据增广是提高神经网络泛化性能的一种重要技术。图结构数据增广通过启发式或概率式的策略扰动图结构,使得节点能够捕获到更加丰富的上下文信息,从而提高图神经网络的泛化性能。虽然近年来已经有很多图结构增广的方法被提出,但很少有工作注意到原始图结构和增广图结构之间可能存在的分布偏移。过于严重的分布偏移会使模型不但不能从图结构增广中受益,反而会损害模型的性能,我们将这个现象称之为负增广问题。

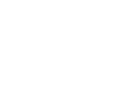

为了解决这个负增广问题,这篇论文提出了一个新颖的基于知识蒸馏的图结构增广框架(Knowledge Distillation Graph Augmentation, KDGA)来缓解分布偏移的负面影响,即利用一个重要的图属性,即图的同质性(graph homophily),分析两种图结构之间的分布偏移,从而度量一个图增广算法遭受负增广问题的严重程度。具体来说,KDGA在增广图结构上训练一个教师模型,然后将教师模型学到的知识蒸馏到一个部分参数共享的学生模型中,最终在原始图结构上测试该学生模型的泛化性能。实验结果表明,KDGA在八个图数据集上都能够显著地提高各种图神经网络架构的泛化性能。所以,文章总结KDGA是一个简单而高效的框架,适用于各种现有的图结构增广方法。

论文链接: https://openreview.net/forum?id=vkGk2HI8oOP

通过梯度去权实现更合理的图结构攻击预算分配

Towards Reasonable Budget Allocation in Untargeted Graph Structure Attacks via Gradient Debias

刘子寒

李子青实验室2020级博士生

<背景知识>

我们的生活中存在着许多可以用点和边表示的数据,比如人和社会关系、原子和化学键、论文和论文间的引用。我们把这类数据称为图结构数据。图神经网络作为处理图结构数据的深度神经网络被广泛地使用。但是,图神经网络和其他深度神经网络一样也面临着鲁棒性的挑战。节点属性和边上的一些不起眼的改变都可能严重破坏图神经网络的性能。本文围绕图对抗攻击——一种探究图神经网络可解释性的方法展开研究,旨在找出对图神经网络来说重要的、易受攻击的数据维度。这种方法既可以用于检验深度学习模型是否是可信任的,也可以用于增强模型对重要维度的训练,使模型的鲁棒性更强。

<技术介绍>

节点分类是图谱中的一项重要任务。该任务通常是给定图中某些节点对应的类别,从而对没有标签的节点进行预测。该任务也被称为半监督节点分类。本文围绕在节点分类任务上的图对抗攻击展开研究。梯度的显著性是找到对模型重要的数据维度的关键手段,在图对抗攻击中受到了广泛的应用。用于对抗攻击的梯度来自于对一个设计的对抗损失的反向传播。在以往的对节点分类任务的对抗攻击中,研究者们思维惯性地采用与分类损失相同的交叉熵函数形式来构造对抗损失。交叉熵损失倾向于为置信度较低的样本产生更显著的梯度。对于分类任务,交叉熵损失可以使模型侧重于对难样本的拟合。然而在对抗攻击中,攻击者的目的是影响全局节点的预测,而无需侧重性地攻击低置信度样本。我们在文中也详细讨论了基于交叉熵的对抗损失会导致攻击方法陷入低效率化的恶性循环。

为了解决这一问题,本文提出了一个基于梯度去权(Gradient Debias,GraD)的对抗损失。GraD能够抵消节点原有的在(伪)标签类别上的置信度对于梯度显著性的影响,从而全局化高效率地找到图结构上重要的维度并施加扰动攻击。

为了证明GraD的有效性,我们在引文网络和社交网络上进行了实验。实验证明了我们的方法在不产生额外运算成本的基础上,其攻击有效性远超先前的方法。此外,我们提供了丰富的可视化分析为我们的理论提供支持。

论文链接: https://openreview.net/forum?id=vkGk2HI8oOP

Unified SSL Benchmark:首个将视觉、语言和音频分类任务进行统一的半监督分类学习基准

USB: A Unified Semi-supervised Learning Benchmark for Classification

王一栋、杨林易

张岳实验室实习生和博后

<背景知识>

当前人工智能的研究基础主要基于在大规模有标记的训练数据上进行有监督的学习。根据Paperswithcode网站统计,在ImageNet这一百万量级的数据集上,传统的监督学习方法可以达到超过88%的准确率。然而,在我们生活中的很多场景中,获取高质量有标签的数据往往要依赖于专家标注。然而,在金融、法律、医疗等领域获得专家标注是昂贵且费时费力的。

为了缓解对标注数据的依赖,半监督学习(Semi-supervised Learning,SSL)致力于在仅有少量的标注数据时利用大量无标签数据(Unlabeled Data)来提升模型的泛化性。半监督学习亦是机器学习的重要主题之一。深度学习之前,这一领域的研究者们提出了诸如半监督支持向量机、熵正则化、协同训练等经典算法。

<技术介绍>

总的来说,目前半监督学习基准存在以下两个问题:

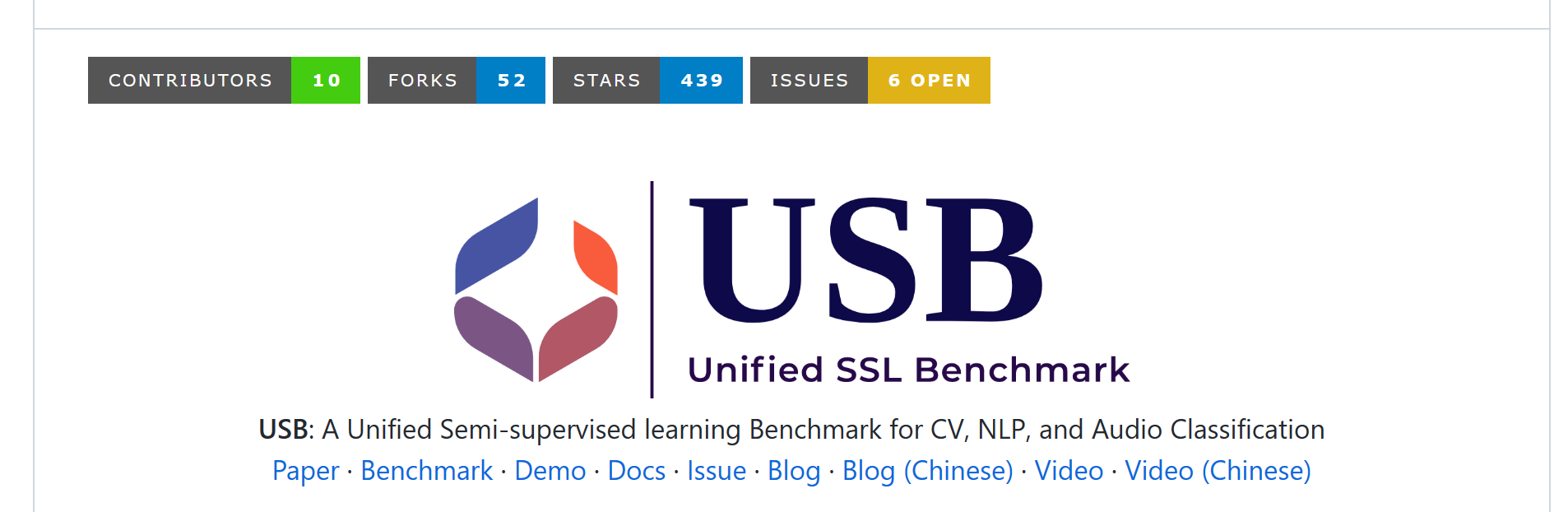

(1)多样性不足。现有的半监督学习基准大多局限于计算机视觉 (CV)分类任务,即CIFAR-10/100,SVHN,STL-10和ImageNet分类),排除了对自然语言处理 (NLP)、音频处理 (Audio) 等分类任务的一致和多样化评估。而在NLP和Audio中缺乏足够的标记数据也是一个普遍问题。

(2)耗时且对学术界不友好。现有的半监督学习基准(如TorchSSL)通常是耗时且不环保的,因为它需要从头开始训练深度神经网络模型。具体来说,使用 TorchSSL评估FixMatch大约需要300个GPU日。

西湖大学联合微软亚洲研究院提出了USB——第一个将视觉、语言和音频分类任务进行统一的半监督分类学习基准,是任务多样化和对研究者更友好的新基准库。与之前的半监督学习基准(TorchSSL)只关注少量视觉任务相比,该论文不仅引入更多样化的应用领域,还首次利用视觉预训练模型大大缩减了半监督算法的验证时间(7000GPU时缩减至900GPU时)。

那么,USB如何一次性解决当前半监督基准存在的问题呢?我们进行了如下的改进:

(1)为增强任务多样性,USB引入了5个CV数据集、5个NLP数据集和5个Audio数据集提供了一个多样化且具有挑战性的基准,从而能够对来自不同领域的多个任务进行一致的评估。下表提供了USB与TorchSSL的详细对比。

(2)为提高训练效率,我们将预训练的Vision Transformer引入SSL,而不是从头训练ResNets。

(3)为了对研究人员更加友好,我们开源实现了14种SSL算法,同时开源了一个模块化代码库和相关的配置文件以供研究者轻松再现USB报告中的结果。

半监督学习通过利用大量无标签数据来训练更精确、更鲁棒的模型,在未来有着重要的研究和应用价值。我们期待通过USB这一工作,能够助力学术界和工业界在半监督学习领域取得更大的进展。

文章链接:https://arxiv.org/pdf/2208.07204.pdf

代码链接:https://github.com/microsoft/Semi-supervised-learning

结构预测神器AlphaFold2的蛋白质功能预测能力评估

Exploring evolution-aware & -free protein language models as protein function predictors

胡名扬、粟锦

原发杰实验室访问学生2022级博士生

<背景知识>

随着深度学习领域的发展,大规模蛋白质语言模型(PLM)在蛋白质预测任务中的取得了显著成绩,比如蛋白质3D结构预测和各种功能预测。其中AlphaFold2是一个具有革命性意义的人工智能蛋白质模型,在CASP14蛋白质结构预测任务上取得了原子级别的预测准确度。该成果可能会重塑结构生物学。然而在蛋白质的研究中,结构仅仅只是开始。对于蛋白质功能的解读,例如,未知蛋白质功能注释、突变影响、蛋白质工程、折叠的稳定性等研究更加具备实际意义。目前,除了结构预测之外,还没有相关研究对于AlphaFold的核心组件Evoformer(一种新颖的PLM)进行结构以外任务的评估检验。

<技术介绍>

针对此,本文研究者探究了三种流行的PLM的表征能力:ESM-1b(单序列PLM)、MSA-Transformer(多序列比对PLM)和 Evoformer(基于结构的PLM),尤其关注Evoforme的能力。

论文旨在回答以下关键问题:

(i)作为 AlphaFold 的核心表征模型,Evoformer是否产生适合蛋白质功能预测任务的特征向量?

(ii)如果是,Evoformer 能否取代目前最强大的PLM,也就是Facebook的ESM-1b和MSA-Transformer?

(iii)这些PLM在多大程度上依赖于同源蛋白的进化数据?

文章通过实证研究比较这些模型,并在此基础上提出新的见解和结论。

三种主流蛋白质语言模型神经网络对比

通过对各种蛋白质相关任务的实验,我们得到以下结论:

(1) 经过AlphaFold2训练的Evoformer组件能够得到对结构和功能预测都有用的表征。

(2) Evoformer产生的表征对于蛋白质或残基级别预测任务都很有用。

(3) Evoformer在结构预测和蛋白稳定性预测方面优于ESM-1b和MSA-Transformer,但在其他功能预测任务上不如ESM-1b。

(4) 与ESM-1b和MSA-Transformer相比,Evoformer在零样本突变任务上表现很差。

(5) 基于进化信息的蛋白质语言模型仅在结构预测任务中优于无进化信息的ESM-1b模型,在大多数功能预测任务中通常比ESM-1b差。

(6) 与结构预测类似,基于进化信息的蛋白质语言模型在预测蛋白质功能时也对MSA的数量比较敏感。

本文通过大量的实验证实:AlphaFold2虽然在蛋白质结构预测任务上取得了革命性的成果,但其核心表征学习组件Evoformer并不能直接带来蛋白质功能预测的显著提升,更不可能替代已有的SOTA,即Facebook研发的ESM-1b与MSA-Transformer。

论文地址:https://arxiv.org/abs/2206.06583

代码数据集:https://github.com/elttaes/Revisiting-PLMs

Tenrec: A Large-scale Multipurpose Benchmark Dataset for Recommender Systems

Tenrec 数据集,一套超大规模的推荐系统公开数据集和评测基准

袁广湖,原发杰

西湖大学、腾讯合作项目

<背景知识>

近些年,通过内容平台浏览视频或阅读文章的用户数量逐渐增加。现有的推荐算法对用户偏好建模水平仍有待提高,因此建立更为准确的推荐系统模型是有必要的。已知的推荐系统基准数据集存在规模小以及用户反馈形式有限等局限性。在这些数据集上评估的推荐系统模型往往缺乏实用性,难以为大规模真实场景的应用提供足够的价值。

<技术介绍>

针对此问题,本文发布了Tenrec数据集——一个超大规模推荐系统数据收集,其记录了来自四种不同推荐场景的各种用户反馈。具体来说,Tenrec有以下五个特点:(1)规模大,包含约500万用户和1.4亿次互动;(2)不仅有正向的用户反馈,也有真实的负反馈;(3)它包含了四种不同场景中重叠的用户和重叠items;(4)它包含了各种类型的用户正反馈,例如点击、点赞、分享形式等;(5)它包含了除了用户ID和item ID之外的附加特征,如用户年龄、性别和items类别等。

论文推出Tenrec数据集,致力于促进推荐系统社区的发展。它是目前最大和最通用的推荐数据集之一,涵盖多个具有各种类型用户反馈的真实场景,其中用户反馈行为包括点击、点赞、分享、关注和真实负反馈等。此外,在Tenrec上的实验结果中,研究者呈现了11个热门推荐系统任务的经典算法。

论文推出Tenrec数据集,致力于促进推荐系统社区的发展。它是目前最大和最通用的推荐数据集之一,涵盖多个具有各种类型用户反馈的真实场景,其中用户反馈行为包括点击、点赞、分享、关注和真实负反馈等。此外,在Tenrec上的实验结果中,研究者呈现了11个热门推荐系统任务的经典算法。

Tenrec可用于CTR预测、序列推荐、多任务学习、迁移学习、用户画像预测、冷启动推荐、终身学习、模型压缩、模型训练加速、模型推理加速和Top-N推荐等相关任务研究。除了上述任务以外,Tenrec 还可以应用于交叉领域推荐,用户不同反馈的迁移和不同负采样的items推荐等任务。Tenrec经过数据脱敏处理,使得用户的个人信息和隐私问题得到了很好的保护。Tenrec有很大的潜力成为一个对多数流行推荐系统任务有用的基准数据集。

论文地址:https://arxiv.org/abs/2210.10629

代码及数据集地址:https://github.com/yuangh-x/2022-NIPS-Tenrec

最新资讯

学术研究

人物故事

大学新闻